Dieser Leitfaden veranschaulicht den Prozess des Ladens von Ketten vom LangChain Hub.

Wie füge ich mithilfe von LangChain einen Speicherstatus in der Kette hinzu?

Der Speicherstatus kann zum Initialisieren der Ketten verwendet werden, da er auf den zuletzt in den Ketten gespeicherten Wert verweisen kann, der bei der Rückgabe der Ausgabe verwendet wird. Um den Prozess des Hinzufügens eines Speicherstatus in Ketten mithilfe des LangChain-Frameworks zu erlernen, gehen Sie einfach diese einfache Anleitung durch:

Schritt 1: Module installieren

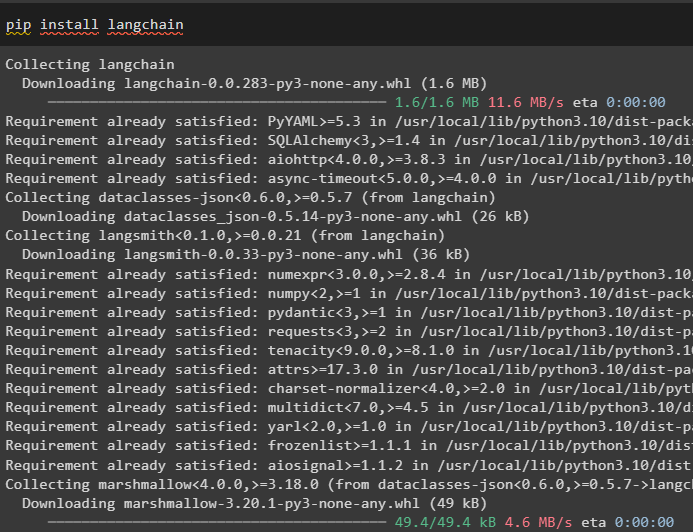

Beginnen Sie zunächst mit dem Prozess, indem Sie das LangChain-Framework mit seinen Abhängigkeiten mithilfe des Befehls pip installieren:

pip langchain installieren

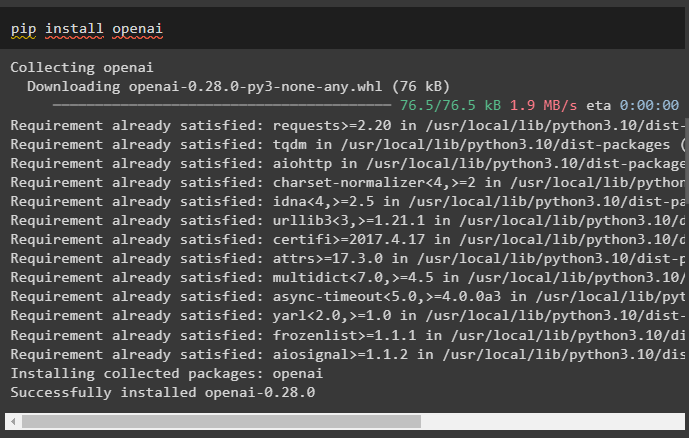

Installieren Sie auch das OpenAI-Modul, um dessen Bibliotheken zu erhalten, die zum Hinzufügen des Speicherstatus in der Kette verwendet werden können:

pip openai installieren

Holen Sie sich den API-Schlüssel vom OpenAI-Konto und Umgebung einrichten Verwenden Sie es, damit die Ketten darauf zugreifen können:

importieren Du

importieren getpass

Du . etwa [ „OPENAI_API_KEY“ ] = getpass . getpass ( „OpenAI-API-Schlüssel:“ )

Dieser Schritt ist wichtig, damit der Code ordnungsgemäß funktioniert.

Schritt 2: Bibliotheken importieren

Nachdem Sie die Umgebung eingerichtet haben, importieren Sie einfach die Bibliotheken zum Hinzufügen des Speicherstatus wie LLMChain, ConversationBufferMemory und viele mehr:

aus langchain. Ketten importieren Konversationsketteaus langchain. Erinnerung importieren ConversationBufferMemory

aus langchain. chat_models importieren ChatOpenAI

aus langchain. Ketten . llm importieren LLMChain

aus langchain. Aufforderungen importieren PromptTemplate

Schritt 3: Ketten aufbauen

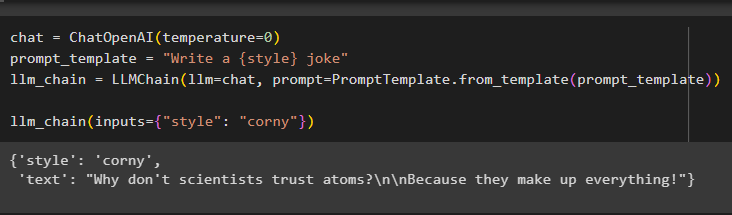

Erstellen Sie nun einfach Ketten für das LLM, indem Sie die OpenAI()-Methode und die Vorlage der Eingabeaufforderung verwenden und die Abfrage verwenden, um die Kette aufzurufen:

Plaudern = ChatOpenAI ( Temperatur = 0 )prompt_template = „Schreib einen {style} Witz“

llm_chain = LLMChain ( llm = Plaudern , prompt = PromptTemplate. von Vorlage ( prompt_template ) )

llm_chain ( Eingänge = { 'Stil' : 'kitschig' } )

Das Modell hat die Ausgabe mithilfe des LLM-Modells angezeigt, wie im folgenden Screenshot dargestellt:

Schritt 4: Speicherstatus hinzufügen

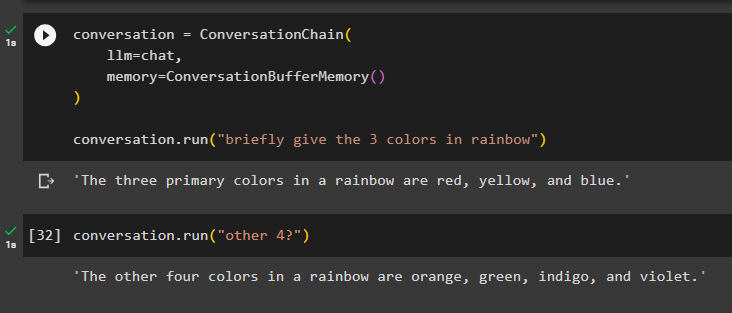

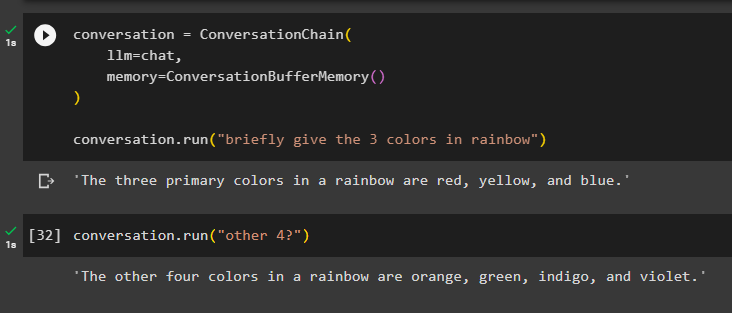

Hier fügen wir den Speicherstatus mithilfe der ConversationBufferMemory()-Methode zur Kette hinzu und führen die Kette aus, um drei Farben aus dem Regenbogen zu erhalten:

Gespräch = Konversationskette (llm = Plaudern ,

Erinnerung = ConversationBufferMemory ( )

)

Gespräch. laufen ( „Gib kurz die 3 Farben im Regenbogen an“ )

Das Modell hat nur drei Farben des Regenbogens angezeigt und der Kontext ist im Speicher der Kette gespeichert:

Hier führen wir die Kette mit einem mehrdeutigen Befehl aus: „ andere 4? „Das Modell selbst holt sich also den Kontext aus dem Speicher und zeigt die restlichen Regenbogenfarben an:

Gespräch. laufen ( „Andere 4?“ )Das Modell hat genau das getan, da es den Kontext verstanden und die restlichen vier Farben aus dem Regenbogenset zurückgegeben hat:

Hier dreht sich alles um Ladeketten von LangChain Hub.

Abschluss

Um den Speicher mithilfe des LangChain-Frameworks in Ketten hinzuzufügen, installieren Sie einfach Module, um die Umgebung für die Erstellung des LLM einzurichten. Anschließend importieren Sie die Bibliotheken, die zum Aufbau der Ketten im LLM erforderlich sind, und fügen dann den Speicherstatus hinzu. Nachdem Sie den Speicherstatus zur Kette hinzugefügt haben, geben Sie einfach einen Befehl an die Kette, um die Ausgabe abzurufen, und geben Sie dann einen weiteren Befehl im Kontext des vorherigen Befehls ein, um die richtige Antwort zu erhalten. In diesem Beitrag wurde der Prozess des Hinzufügens eines Speicherzustands in Ketten mithilfe des LangChain-Frameworks erläutert.